「奇点」AI计算平台细节曝光!竟是微软四年前老项目重生

AI服务渠道的成本和效率问题,是各大服务供给商一向着力处理和改善的难题。

具体而言,便是怎么在满足客户需求的同时,尽量降低整个体系资源的耗费,以及怎么经过进步深度学习作业负载的使用率来降低成本。

近来,微软 Azure 研究团队协作构建了一个新的 AI 基础设施服务,代号为「Singularity」。用研究人员的话说,这是「一个全新的人工智能渠道服务,将成为微软内部和外部人工智能的主要驱动力。」

Singularity 服务旨在为数据科学家和 AI 从业者供给一种在微软专为 AI 构建的分布式基础架构服务上构建、扩展、实验和迭代其模型的办法。

论文地址:

https://arxiv.org/pdf/2202.07848.pdf

在一篇体系介绍Singularity 服务的论文中,研究人员表明:

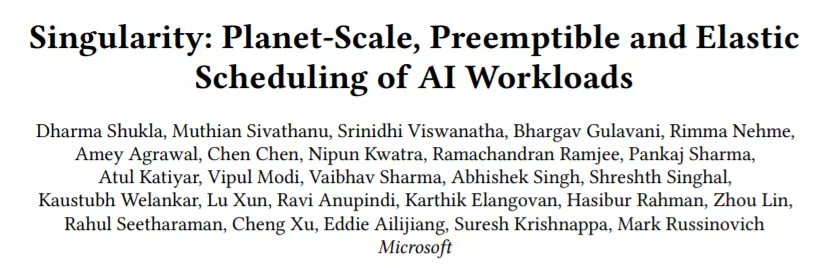

「Singularity 的核心是一种新颖的、能够感知作业负载的调度程序,能够透明地抢占和弹性扩展深度学习作业负载,在不影响正确性和功用的情况下,进步全球范围内的 AI 加速器(例如 GPU、FPGA)的使用率。」

据介绍,运用Singularity服务,活动作业负载能够动态且透明地占用并迁移到一组不同的节点、集群、数据中心或区域,并准确执行,还能够在给定类型的一组不同的加速器上调整巨细(即弹性缩放)。

Singularity渠道架构示意图

用户无须对代码进行任何更改,也不需要运用任何或许限制灵活性的自定义库。微软表明,这种办法显著进步了深度学习作业负载的可靠性。

这篇论文的作者包括 Azure 首席技能官 Mark Russinovich;协作伙伴架构师 Rimma Nehme,他曾在 Azure Cosmos DB 作业,直到 2019 年转到 Azure 从事人工智能和深度学习作业;以及技能研究员 Dharma Shukla等。

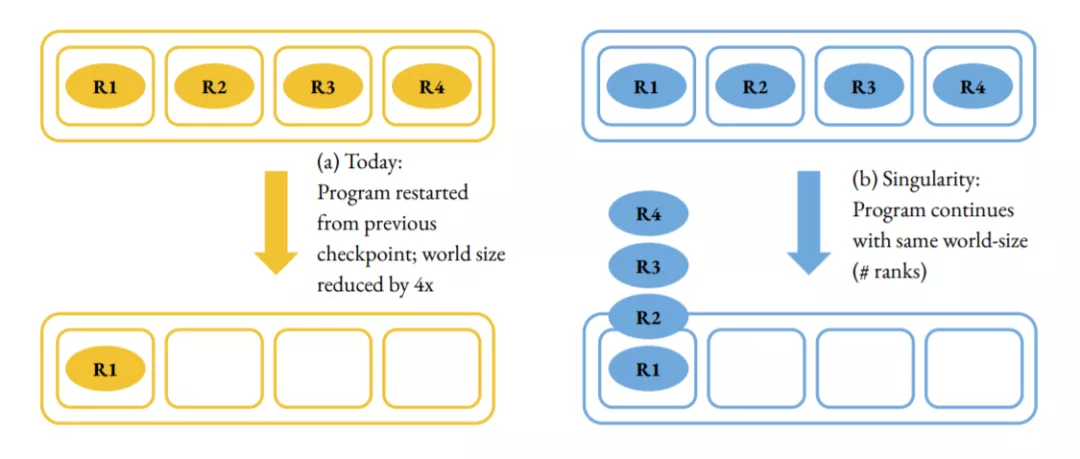

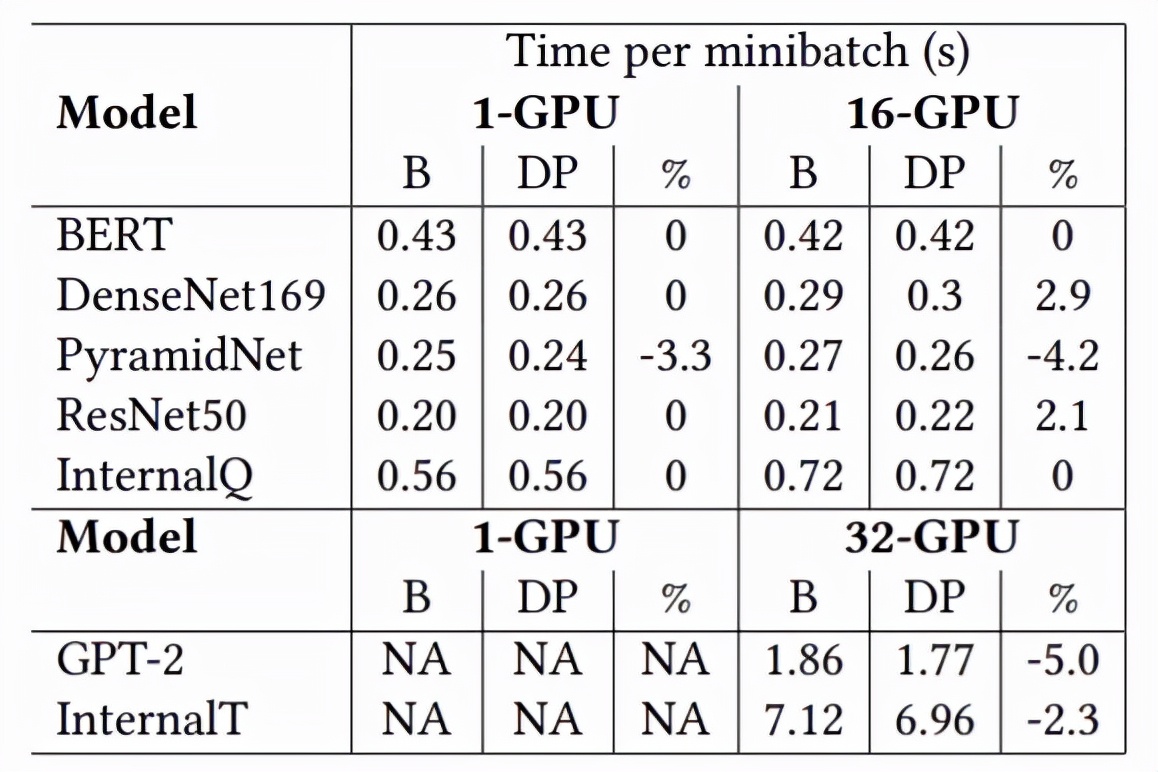

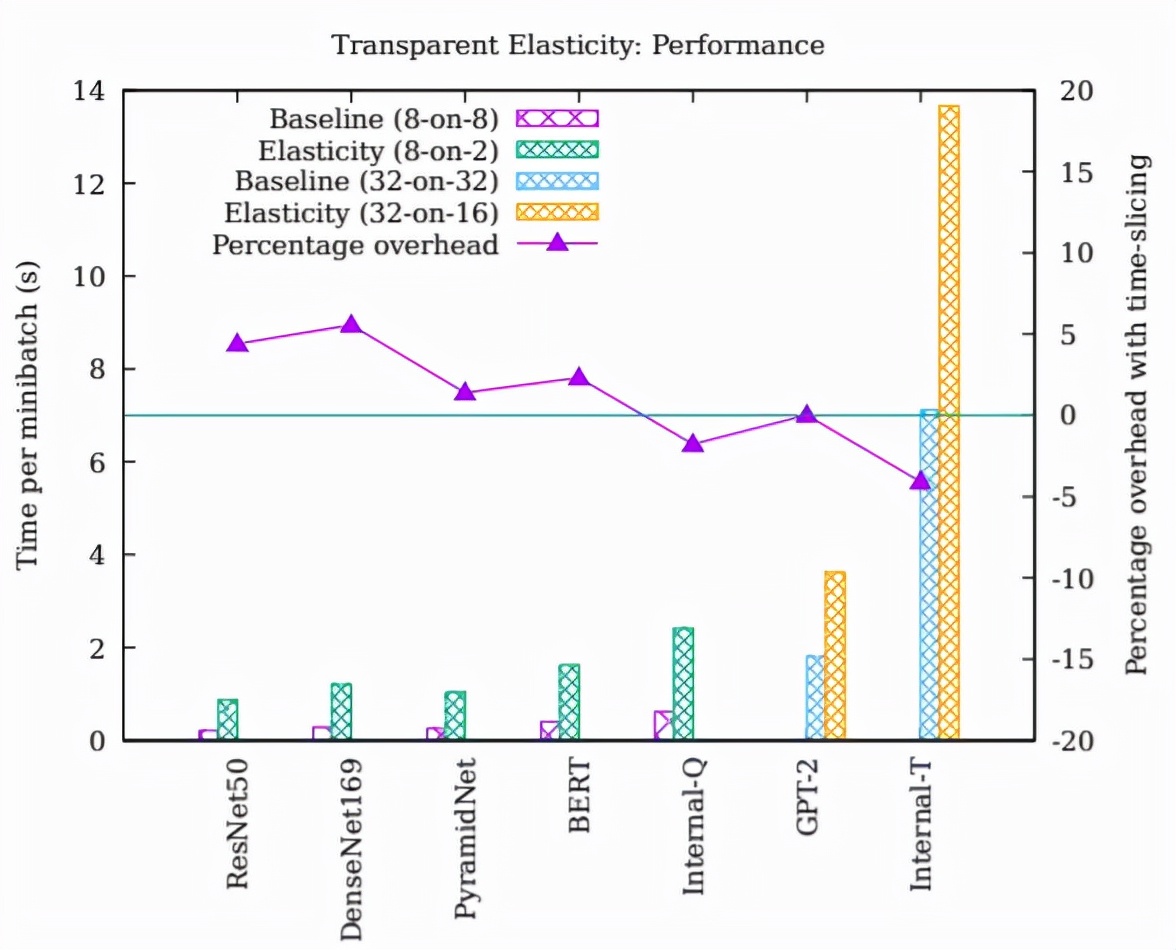

和今日运用的弹性负载调度机制相比,Singularity调度程序能够将每个 worker 1对1映射到物理 GPU,或者运用多对一映射,将物理 GPU 虚拟化并跨多个 worker 进行时间切片,world-size不变。

相比之下,目前的弹性机制调度程序会将作业从上一个检查点重新启动,world-size减小至四分之一,导致资源糟蹋(比如自上一个检查点以来的初始化和迭代需要重做)。

测验成果显示,在不同模型上,运用Singularity服务(DP)相对基线水平(B)取得的功用提高。

在透明弹性负载调度功用上,Singularity则取得了7%的平均优势。

研究人员表明,Singularity在调度深度学习作业负载方面完成了重大突破,将比如弹性等小众特征转化为干流特征,并在此基础上完成了对深度学习作业负载的调度。

Singularity完成了史无前例的作业负载可替换性水平。作业负载能够使用全球分布的机群中的任何地方的空闲资源。

Singularity供给简略的用户体验:用户只需要重视机器学习任务自身,而不需要考虑检查点或弹性负载问题。这些基础设施的优化对用户是彻底透明的。

四年前的老项目「重生」?

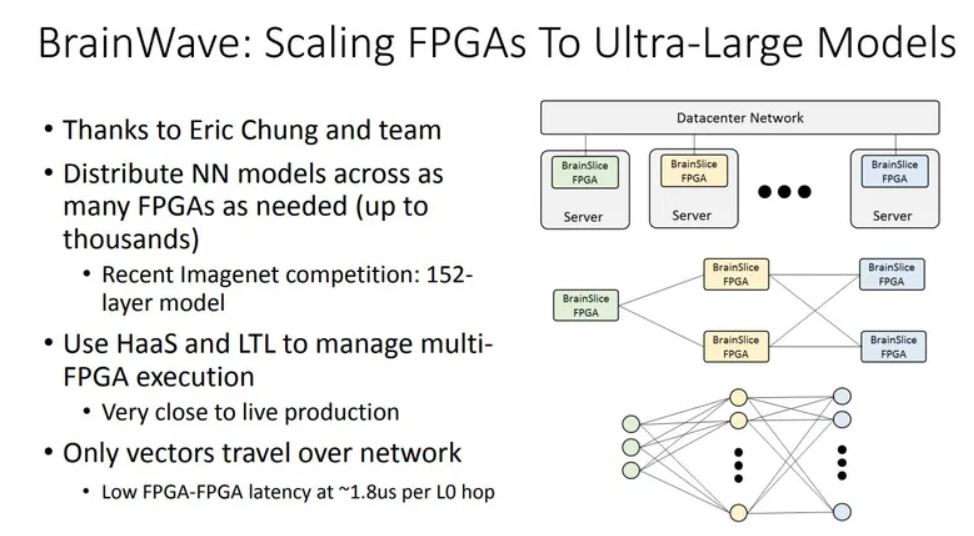

ZD Net报导称,Singularity 或许是将微软此前推出的 Brainwave 项目面向商业化的下一个阶段。

微软此前曾讨论过将 FPGA 或现场可编程门阵列作为服务供给给客户的方案。

2018 年,微软公开了其旨在 Azure 中供给快速 AI 处理和核算能力的「Brainwave」项目。

其时,微软在云端供给了由 Brainwave 供给支持的 Azure 机器学习硬件加速模型的预览——一个向客户供给面向 AI 作业负载的 FPGA 处理渠道。

Brainwave 由高功用分布式体系架构组成;运行在可定制芯片(FPGA)上的硬件深度神经网络引擎,用于布置练习模型的编译器。

实际上,这不是微软在自家渠道上第一次运用Singularity这个词了。微软之前就曾将 Singularity 用来命名微内核操作体系,以及一组彻底以保管代码开发的相关东西和资源库。

Singularity 最终催生和/或影响了微软的其他几个云渠道和操作体系项目,对 Barrelfish、 Helios、 Midori和 Drawbridge等项目均产生了不小的影响。

AI核算渠道,大厂争相布局

值得注意的是,在人工智能高功用核算和加速核算渠道的构建上,微软早就开端布局了。

2019年,微软在OpenAI上出资了10亿美元,并在一年后宣告,他们已经与OpenAI协作并专门为OpenAI制作了第五强大的公开记录超级核算机。

尽管微软与OpenAI协作制作的AI超级核算机专门用于OpenAI,但微软一向表明,他们方案经过Azure AI服务和GitHub,想更多的用户供给大型AI模型和练习优化东西。

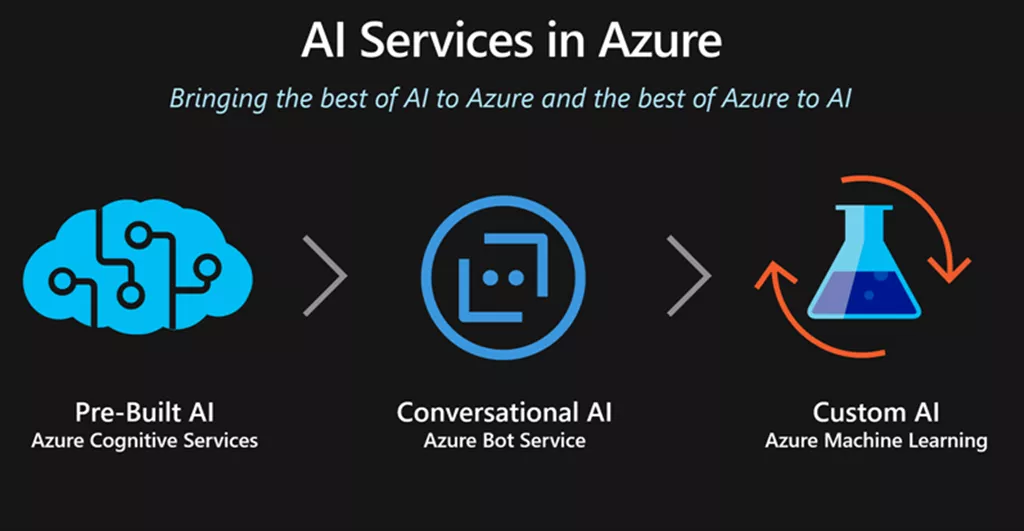

微软还在其「Azure AI」旗下向不需要专用超级核算机的客户供给各种加速核算服务。

2021年11月,微软宣告将在Azure中运用 80GB NVIDIA A100 GPU,以扩大其AI超级核算机阵型。

而且,微软并不是唯一一家企图在内部和客户中供给人工智能超级核算功用的科技公司。Meta也在做相同的工作,如无意外,Meta已经将这项作业定位为解锁元宇宙的关键。